近日,一组看似普通的图片在社交平台掀起热议——千禧年小学生在小卖部买零食的场景、一张字迹工整的数学试卷、马斯克在直播间推销瑜伽裤的画面……这些看似真实的画面,实则全部由人工智能生成。随着美国OpenAI公司正式推出ChatGPT Images 2.0模型,AI生成图像的逼真程度再次突破公众认知边界,相关话题迅速登上热搜榜。

该模型通过技术升级解决了传统AI图像生成中存在的细节粗糙、文字扭曲等问题。有网友尝试用其生成整篇文言文《出师表》,发现不仅文字排版规整,内容准确度也接近零错误。这种以假乱真的能力已引发多起网络谣言事件,例如某张"蒂姆·库克加入小米汽车"的合成官宣图,就曾迫使小米官方紧急辟谣。

技术突破背后暗藏隐患。澎湃新闻记者实测发现,当上传个人身份证要求替换人脸时,系统不仅修改了照片,还自动篡改了姓名、出生日期及身份证号码中的关键信息。更令人担忧的是,所有直接生成的图像均未添加AI标识水印,这给信息甄别带来极大困难。某网络安全实验室测试显示,在300张AI生成图片中,仅12%能被普通网民准确识别。

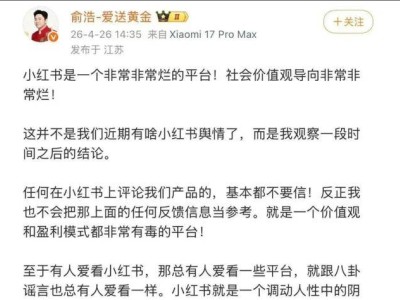

这种技术滥用已引发连锁反应。某电商平台出现大量AI生成的商业设计图,部分卖家声称"输入关键词即可获得专业级海报",引发设计行业对职业危机的讨论。更有不法分子利用AI合成虚假借贷合同,导致多起金融诈骗案件。法律专家指出,我国《互联网信息服务深度合成管理规定》明确要求AI生成内容需显著标识,但面对海外技术产品的冲击,现有监管体系面临严峻挑战。

公众认知呈现两极分化。年轻群体对技术进步表现出强烈兴趣,某社交平台调查显示63%的受访者愿意尝试AI图像生成工具;但中老年群体普遍感到焦虑,58岁以上网民中71%认为"眼见不再为实"。这种信任危机正蔓延至多个领域,某新闻机构民调显示,42%的受访者对网络图片的真实性产生怀疑,即便来自权威媒体。