群核科技在近日举办的首届技术开放日上,震撼发布了其空间大模型的最新研究成果:升级版空间语言模型SpatialLM 1.5和空间生成模型SpatialGen。同时,公司还向与会者透露了新模型后续的开源计划。这一大模型体系专注于3D室内场景的认知与生成,展示了在真实感全息漫游、结构化可交互性以及复杂室内场景处理上的卓越能力。

除了开源模型,群核科技还首次分享了AI团队基于SpatialGen探索的AI视频生成解决方案,该方案旨在通过创新的范式解决AI视频中时空一致性的难题。

SpatialLM 1.5,作为此次发布的亮点之一,是一款基于大语言模型训练的空间语言模型。它能通过对话交互系统SpatialLM-Chat,实现可交互场景的端到端生成。与传统大语言模型相比,SpatialLM 1.5不仅理解文本指令,还能输出包含空间结构、物体关系、物理参数的“空间语言”。用户只需输入简单文本描述,该模型便能自动生成结构化场景脚本,智能匹配家具模型并完成布局,之后还支持通过自然语言进行问答或编辑。

更重要的是,SpatialLM 1.5生成的场景富含物理正确的结构化信息,并能快速批量输出大量符合要求的多样化场景。这些场景可用于机器人路径规划、避障训练、任务执行等,有效解决机器人训练数据缺乏的问题。在现场演示中,群核科技首席科学家周子寒展示了机器人在养老场景中的应用,模型不仅理解了相关物体对象,还自动规划出最优行动路径,展示了机器人在复杂家庭环境中执行任务的潜力。

SpatialLM的前代版本1.0在今年3月开源后,迅速登上Hugging Face趋势榜前三,已有初创企业基于其代码和架构训练出自有模型,这充分验证了开源模式的技术影响力。

而SpatialGen则专注于“生成与呈现”,它是一款基于扩散模型架构的多视角图像生成模型。根据文字描述、参考图像和3D空间布局,SpatialGen能生成具有时空一致性的多视角图像,并进一步生成3D高斯场景,渲染出漫游视频。依托群核科技的海量室内3D场景数据与多视角扩散模型技术,SpatialGen生成的多视角图像能确保同一物体在不同镜头下保持准确的空间属性和物理关系。用户可以在生成的3D高斯场景和真实感全息漫游视频中自由穿梭,获得沉浸式的体验。

群核科技AI产品总监龙天泽提到,现有的AIGC文生视频与图生视频工具虽已初步推动了全民视频创作的潮流,但由于时空一致性问题的制约,离真正的商业化应用还有一定距离。群核科技正在研发一款基于3D技术的AI视频生成产品,计划在今年内正式发布,这或将成为全球首款深度融合3D能力的AI视频生成工具。通过构建3D渲染与视频增强一体化的生成管线,有望弥补当前AIGC视频生成中时空一致性不足的问题。

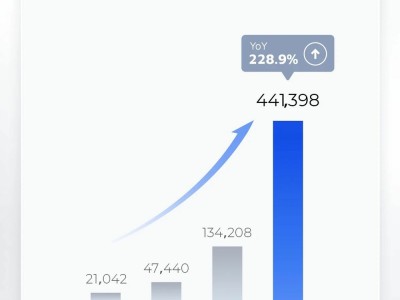

群核科技联合创始人兼董事长黄晓煌在活动现场分享了公司在空间智能布局上的最新思考。基于酷家乐这一全球最大的空间设计平台,群核科技构建了“空间编辑工具-空间合成数据-空间大模型”的空间智能飞轮,工具沉淀数据,数据加速模型训练,模型提升工具体验,工具广泛应用中再沉淀丰富的场景数据。截至2025年6月30日,群核科技拥有超过4.41亿个3D模型及超过5亿个结构化3D空间场景。

黄晓煌表示,开源是公司战略的重要关键词之一。自2018年起,群核科技便启动了开源战略,逐步开放数据和算法能力。当前,空间大模型还处于初级阶段,群核科技希望通过开源推动全球空间智能技术快速发展,成为全球空间智能服务提供商,推动空间大模型迎来属于自己的“DeepSeek时刻”。

据悉,技术开放日上分享的两款模型将逐步在HuggingFace、GitHub、魔搭社区等平台向全球开发者开源。其中,空间生成模型SpatialGen在技术开放日当天已可在开源网站下载使用,而空间语言模型SpatialLM 1.5也将以“SpatialLM-Chat”的形式完成开源。